เผยแพร่เมื่อวันที่ 30 เมษายน 2026 เวลา 15:30 น. EDT

ประสบการณ์ของ Afam ในการเผยแพร่เทคโนโลยีย้อนกลับไปในปี 2018 เมื่อเขาทำงานให้กับ Make Tech Easier ในช่วงหลายปีที่ผ่านมา เขาได้สร้างชื่อเสียงจากการเผยแพร่คำแนะนำ บทวิจารณ์ เคล็ดลับ และบทความอธิบายคุณภาพสูง ครอบคลุมถึง Windows, Linux และเครื่องมือโอเพ่นซอร์ส ผลงานของเขาได้รับการนำเสนอบนเว็บไซต์ชั้นนำ รวมถึง Technical Ustad, Windows Report, Guiding Tech, Alphr และ Next of Windows

เขาสำเร็จการศึกษาระดับปริญญาตรีสาขาวิทยาการคอมพิวเตอร์และเป็นผู้สนับสนุนอย่างแข็งขันในด้านความเป็นส่วนตัวและความปลอดภัยของข้อมูล พร้อมด้วยเคล็ดลับ วิดีโอ และบทช่วยสอนมากมายเกี่ยวกับหัวข้อที่เผยแพร่บนช่อง YouTube ของ Fuzo Tech

เมื่อเขาไม่ได้ทำงาน เขาชอบที่จะใช้เวลาอยู่กับครอบครัว ปั่นจักรยาน หรือดูแลสวน

ฉันไม่เคยคิดว่ามันจะท้าทายขนาดนี้ในการใช้งาน LLM ท้องถิ่นบน Windows แม้ว่าจะดูเหมือนปกติดี แต่ฉันก็รู้ในภายหลังว่าอินสแตนซ์นั้นทำงานบน CPU ของฉันทั้งหมด การกำหนดค่าไดรเวอร์ ตัวแปรสภาพแวดล้อม และการตั้งค่า WSL2 ในที่สุดหลังจากการดึงโมเดล Ollama ให้ความรู้สึกเหมือนเป็นโปรเจ็กต์ที่แยกจากกัน และหลังจากนั้น ฉันพบว่าการรักษาสแต็กนั้นเหนื่อยมาก

ฉันรู้สึกประหลาดใจมากเมื่อได้ลองใช้บน Linux กระบวนการนี้ตรงไปตรงมามากขึ้น ง่ายขึ้น และพูดตามตรง ฉันไม่ได้คาดหวังให้สิ่งต่าง ๆ พังอีกต่อไป รู้สึกคล้ายกับตอนที่ฉันเปลี่ยนเทอร์มินัล Linux ให้เป็นผู้ช่วย AI ในพื้นที่

การตั้งค่าที่ควรใช้เวลาสิบนาที

ทำไม Ollama บน Windows ถึงดึงคุณกลับเข้ามา

กระบวนการติดตั้งสำหรับ Ollama บน Windows อาจดูตรงไปตรงมา แต่ในความเป็นจริงแล้ว นอกเหนือไปจากการดาวน์โหลดและเรียกใช้โปรแกรมติดตั้งแล้ว ในการวิ่งครั้งแรก คุณอาจมั่นใจว่าทุกอย่างสมบูรณ์แบบเพราะคุณจะได้รับข้อความและการตอบกลับ อย่างไรก็ตาม ให้ตรวจสอบด้วยคำสั่ง:ollama ps เผยให้เห็น GPU ที่ไม่ได้ใช้งาน นี่เป็นเพราะมันทำงานบน CPU และโทเค็นเพียง 3 ถึง 5 โทเค็นต่อวินาทีนั้นช้ากว่าที่ควรจะเป็นอย่างมาก

ทางเลือกสำรองเริ่มต้นของ Ollama เป็นเรื่องปกติและตรวจพบได้ยากเนื่องจากไม่มีข้อผิดพลาด ลักษณะการทำงานนี้อาจเกิดขึ้นได้บน OS อื่นๆ หาก VRAM ที่มีอยู่น้อยเกินไปสำหรับรุ่นดังกล่าว อย่างไรก็ตาม บน Windows ปัจจัยอื่นๆ หลายประการ เช่น สภาวะการแข่งขันของไดรเวอร์/ตัวติดตั้ง การแพร่กระจายตัวแปรสภาพแวดล้อม และการใช้ทรัพยากรที่แข่งขันกัน สามารถทริกเกอร์ได้

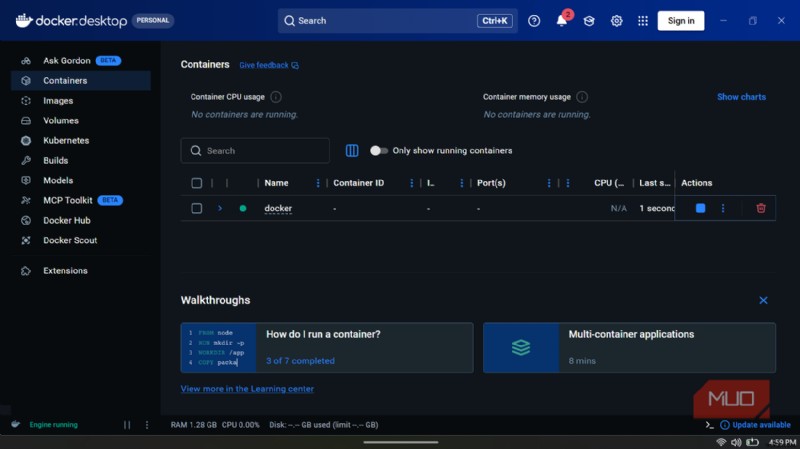

แม้ว่าจะดูเหมือนไม่มีอะไรผิดปกติ แต่ก็ยังสามารถล้มเหลวได้ ในกรณีดังกล่าว คุณอาจหันไปใช้ WSL2 ฉันลองใช้ Open WebUI ผ่าน Docker ซึ่งทำให้ Ollama รู้สึกเหมือน ChatGPT ในเครื่อง แม้ว่าจะเป็นบริการบนเบราว์เซอร์ก็ตาม อย่างไรก็ตาม Docker ทำงานได้อย่างน่าเชื่อถือที่สุดบน Windows จาก WSL2 นี่คือสภาพแวดล้อม Linux ที่ทำงานภายใน Windows และคุณต้องกำหนดค่าอย่างระมัดระวังเพื่อหลีกเลี่ยงความยุ่งยากใดๆ

แน่นอนในที่สุดคุณก็จะทำให้มันถูกต้องในที่สุด อย่างไรก็ตาม ปัญหาเล็กๆ น้อยๆ ก็คือ กระบวนการนี้ไม่เคยรู้สึกว่าเสร็จสิ้นแล้วจริงๆ มันเป็นวงจรของการแก้ไขสิ่งหนึ่ง แล้วอีกอย่างหนึ่ง แล้วอีกอย่างหนึ่ง คุณไม่สามารถคาดเดาได้ว่าจะใช้เวลานานแค่ไหนในการตั้งค่าการทำงาน อาจใช้เวลาห้านาทีหรือห้าชั่วโมง

ที่เกี่ยวข้อง

ที่เกี่ยวข้อง

5 คำสั่งเทอร์มินัล Linux ที่แก้ไขปัญหาระบบส่วนใหญ่ของฉัน

คำสั่งการแก้ปัญหา Linux ที่สำคัญที่ผู้ใช้ทุกคนควรรู้

จริงๆ แล้วการติดตั้ง Linux เป็นอย่างไร

คำสั่งเดียว GPU ทำงานอยู่ และไม่มีอะไรเหลือให้กำหนดค่า

เมื่อเปรียบเทียบกันแล้ว การติดตั้ง LLM ภายในเครื่องบน Linux นั้นไม่มีเหตุการณ์ใดๆ ฉันเปลี่ยนจากคำสั่งการติดตั้งคำสั่งเดียวเป็นการดาวน์โหลดโมเดล โดยตรวจพบ GPU แค่นั้นเอง เมื่อฉันสร้างการตอบกลับครั้งแรก ฉันก็นั่งเฉยๆ เผื่อมีอะไรต้องแก้ไข ไม่มี

นี่ไม่ใช่คำถามว่าระบบปฏิบัติการใดดีกว่า มันเป็นเพียงความจริงที่ว่าสคริปต์การติดตั้งสำหรับ Ollama ถูกเขียนขึ้นครั้งแรกสำหรับ Linux และทำงานได้อย่างไม่มีที่ติ ตั้งแต่การติดตั้งไบนารีและการลงทะเบียน Ollama เป็นบริการพื้นหลังที่เริ่มต้นด้วยระบบ ไปจนถึงการตรวจจับฮาร์ดแวร์ GPU โดยอัตโนมัติ สิ่งเหล่านี้ไม่จำเป็นต้องมีการเชื่อมโยงเลเยอร์หรือการแปลสภาพแวดล้อม ตราบใดที่ไดรเวอร์ทั้งหมดอยู่ในตำแหน่งก่อนการติดตั้ง กระบวนการทั้งหมดจะจัดการเอง

หากการตรวจจับ GPU ล้มเหลวเนื่องจากคุณทำการติดตั้งก่อนที่ไดรเวอร์จะได้รับการยืนยัน เพียงติดตั้ง Ollama ใหม่เพื่อแก้ไข

จากประสบการณ์ของผม นี่คือการเปรียบเทียบกระบวนการในระบบปฏิบัติการทั้งสอง:

<หัว>ขั้นตอน

หน้าต่าง

ลินุกซ์

ติดตั้ง Ollama

ตัวติดตั้ง .exe (การใช้ GPU ต้องมีการตรวจสอบแยกต่างหาก)

หนึ่งคำสั่ง (GPU ตรวจพบโดยอัตโนมัติ)

GPU ใช้งานจริงในการรันครั้งแรก

มักจะถอยกลับไปที่ CPU โดยไม่โต้ตอบ

ใช้ทันทีหากมีไดรเวอร์อยู่

เปิดการตั้งค่า WebUI

จำเป็นต้องติดตั้ง WSL2 และกำหนดค่า Docker ภายใน

คำสั่งนักเทียบท่าเดี่ยว

การเร่งความเร็ว GPU ของ AMD

ทดลอง (ROCm เวอร์ชัน 6.1+, รายงาน CPU สำรองบ่อยครั้ง)

การสนับสนุนอย่างเต็มที่ผ่านทาง ROCm v7

Ollama ทำงานเมื่อเริ่มต้น

ต้องมีการกำหนดค่าด้วยตนเอง

อัตโนมัติผ่าน systemd

รองรับ Windows — Linux เป็นที่ที่เขียน

เมื่อคุณอยู่ในระบบนิเวศได้นานพอ คุณจะพบว่า Ollama, Open WebUI และ Docker ไม่ได้ถูกสร้างขึ้นสำหรับ Windows และไม่มีการบูรณาการ Python ล้อมรอบสิ่งเหล่านั้น มีการรองรับ Windows ทับซ้อน และสร้างความแตกต่างอย่างมีนัยสำคัญ

ตัวอย่างที่ดีที่สุดคือ Open WebUI ซึ่งเป็นคำสั่ง Docker เดียวบน Linux คำสั่งนี้จะเริ่มคอนเทนเนอร์ที่เชื่อมต่อกับอินสแตนซ์ในเครื่องของ Ollama ทันทีในขณะที่คุณเปิดเบราว์เซอร์ บน Windows คุณกำลังกำหนดค่าองค์ประกอบเหล่านี้ทั้งหมด ใช้งานได้ แต่บ่อยครั้งจะไม่เกิดขึ้นเมื่อคุณพยายามครั้งแรก ซึ่งโดยทั่วไปจะนำไปสู่กระบวนการแก้ไขข้อบกพร่องที่ใช้เวลานาน

ปัญหาเหล่านี้ซับซ้อนยิ่งขึ้นสำหรับผู้ใช้ AMD GPU มีการรองรับ Linux เต็มรูปแบบสำหรับ ROCm เวอร์ชัน 7 ซึ่งเป็นแพลตฟอร์มการคำนวณของ AMD สำหรับการอนุมาน GPU บน Windows การสนับสนุนอย่างเป็นทางการจะหยุดทำงานที่เวอร์ชัน 6.1+ และยังคงอยู่ในช่วงทดลอง ด้วยเหตุนี้ ผู้ใช้ Windows จำนวนมากของ AMD GPU ยังคงใช้งาน Ollama บน CPU โดยไม่คำนึงถึงความสามารถด้านฮาร์ดแวร์ของพวกเขา สแต็ก GPU พื้นฐานไม่พร้อมใช้งาน

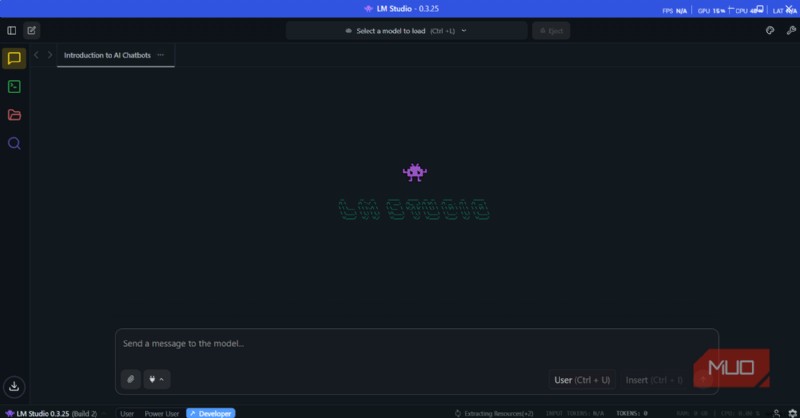

พิจารณาใช้ LM Studio เป็นเครื่องมือแยกต่างหากจาก Ollama เน้น GUI เป็นหลัก ทำงานได้อย่างหมดจดบน Windows และ Linux และให้คุณเรียกใช้โมเดลต่างๆ โดยไม่ต้องใช้เทอร์มินัล อย่างไรก็ตาม จะใช้งานได้เฉพาะเมื่อคุณต้องการสนทนากับ LLM ในพื้นที่โดยไม่ต้องทำอะไรมากไปกว่านี้

เวลาที่คุณประหยัดไม่ได้ชำระล่วงหน้า

แม้ว่าฉันจะพบว่าการติดตั้งครั้งแรกนั้นลื่นไหลมาก แต่ฉันก็รู้สึกซาบซึ้งว่า LLM ในพื้นที่ทำงานบน Linux อย่างไรมากขึ้นเมื่อใช้การตั้งค่าของฉันในแต่ละครั้ง เหตุผลก็คือไม่ใช่การติดตั้งเพียงครั้งเดียวที่คุณจะใช้ตลอดไป คุณยังคงลองใช้รุ่นที่ใหม่กว่าเมื่อมีวางจำหน่าย คุณกำลังลองใช้เวอร์ชันที่เล็กลงและมีปริมาณน้อยลงอย่างต่อเนื่อง เนื่องจากโมเดลช้าเกินไป

ทั้งหมดนี้จำเป็นต้องมีการเปลี่ยนแปลงระดับระบบ อาการแทรกซ้อนเริ่มแรกบน Windows อาจเกิดขึ้นอีกเมื่อคุณทำการเปลี่ยนแปลง และจะทำให้ประสบการณ์ของคุณกับ LLM ในพื้นที่ไม่เป็นที่พอใจอย่างยิ่งเท่านั้น

หากคุณต้องการลองใช้ Linux เพื่อประโยชน์ของ LLM ในพื้นที่ ฉันขอแนะนำให้คุณใช้ Linux Mint อาจเป็น distro ที่ดีที่สุดสำหรับทุกคนที่มาจากระบบนิเวศของ Windows

ระบบปฏิบัติการ ลินุกซ์

ข้อมูลจำเพาะ CPU ขั้นต่ำ ซิงเกิลคอร์ 64 บิต

ข้อกำหนด RAM ขั้นต่ำ 1.5 กิกะไบต์

Linux Mint เป็นระบบปฏิบัติการโอเพ่นซอร์สยอดนิยม ฟรี สำหรับเดสก์ท็อปและแล็ปท็อป มันใช้งานง่าย มีเสถียรภาพ และใช้งานได้ทันที