หากคุณติดตามการพัฒนาใหม่ใน AI และเทคโนโลยี คุณจะต้องเคยเห็นผู้มีอิทธิพลทางเทคโนโลยีมากมายที่แนะนำการตั้งค่าโมเดลภาษาขนาดใหญ่ในท้องถิ่นหรือ LLM เมื่อฉันได้ยินแนวคิดของ LLM ที่เน้นความเป็นส่วนตัวซึ่งทำงานอย่างสมบูรณ์บนพีซีของฉัน ฉันก็ตื่นเต้นและลองใช้ทันที ประเด็นนี้ — แม้ว่า LLM ในพื้นที่จะมีประโยชน์ในกรณีการใช้งานที่เฉพาะเจาะจง แต่จะไม่แทนที่ ChatGPT หรือ AI เทคโนโลยีขนาดใหญ่อื่นๆ ในขณะที่ทำงานบนเวิร์กสเตชันของคุณ ให้ฉันอธิบายว่าทำไม…

สารบัญ

Local LLM กับ ChatGPT:การตรวจสอบความเป็นจริง

ปัญหาคอขวดประการแรกและสำคัญที่สุดที่คุณจะพบคือข้อจำกัดของฮาร์ดแวร์ ฉันเป็นผู้ใช้แล็ปท็อปทั่วไปที่ไม่ใช่เกมซึ่งเป็นเจ้าของแล็ปท็อป Dell Latitude 5520 พร้อม RAM 3200 MHz ขนาด 64 GB และ NVMe M.2 SSD สองตัวพร้อมพื้นที่จัดเก็บข้อมูลที่รวดเร็วมากกว่า 1 TB อย่างไรก็ตาม เวิร์กสเตชันส่วนใหญ่ในสนามเบสบอลแห่งนี้ไม่มี GPU เฉพาะหรือมีรุ่นราคาประหยัดติดตั้งไว้ตั้งแต่แกะกล่อง

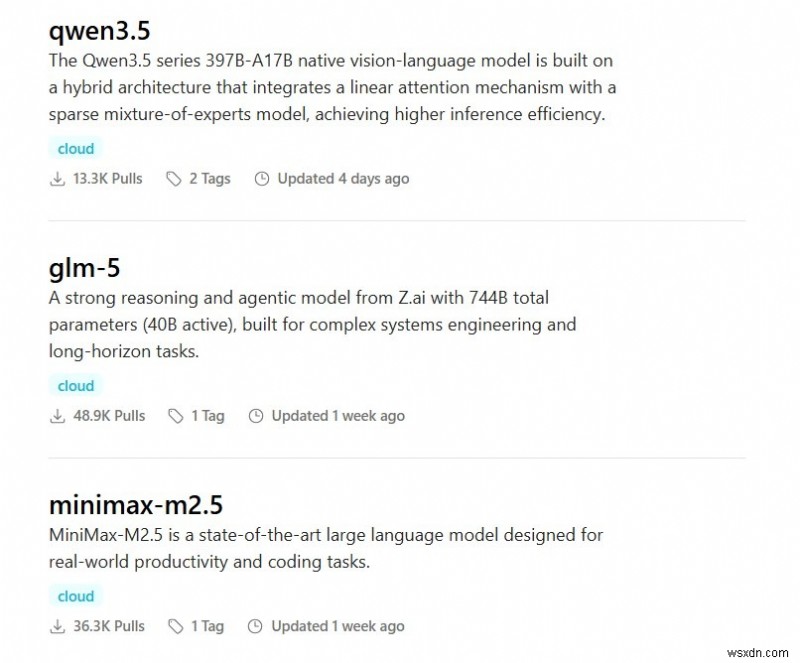

สิ่งที่ใช้งาน LLM ในเครื่องก็คือ พวกเขาพึ่งพา RAM และพื้นที่เก็บข้อมูลน้อยลง และพึ่งพาพลังการประมวลผลของพีซีของคุณมากขึ้น ซึ่งก็คือ CPU และ GPU ดังนั้นโปรเซสเซอร์ i7 ของฉันที่มี Intel Integrated Graphics ไม่สามารถใช้งานโมเดลมัลติโมดัลที่ใหญ่กว่าได้ โชคดีที่ฉันยังมีตัวเลือกมากมาย เช่น lfm2.5-thinking:1.2b , รัฐมนตรี-3:3b และ หินแกรนิต4:3b พร้อมด้วย llama3 ที่ได้รับความนิยมมากกว่า และ phi3 โมเดล

ตอนนี้ เรามาคำนวณการเปรียบเทียบในมุมมองกันดีกว่า lfm2.5 ซึ่งโดยพื้นฐานแล้วคือโมเดลภาษาขนาดเล็ก (SLM) ซึ่งทำงานบนพีซีทั่วไปเช่นของฉัน มีข้อจำกัดใหญ่ๆ สองประการ:พลังการประมวลผลน้อยมาก และจำนวนพารามิเตอร์หรือสมองของ SLM น้อยกว่า ในการเปรียบเทียบ LLM ระบบคลาวด์ เช่น ChatGPT ประมวลผลข้อมูลจำนวนเทราไบต์ในไม่กี่วินาทีขณะทำงานบนซูเปอร์คอมพิวเตอร์ที่แท้จริง

เมื่อคำนึงถึงคณิตศาสตร์นั้นแล้ว เรามาดูคำตอบบางส่วนของ lfm2.5-thinking:1.2b ในท้องถิ่นกัน และ ChatGPT เวอร์ชันฟรี หลังจากแสดงข้อจำกัดให้คุณแล้ว เราจะดูกรณีการใช้งานที่ SLM ในพื้นที่โดดเด่นกว่า LLM เชิงพาณิชย์จริงๆ

การทดสอบลอจิก:ในกรณีที่ LLM ท้องถิ่นล้มเหลว

หมายเหตุ: จุดประสงค์ของการเปรียบเทียบนี้ไม่ได้เพื่อตำหนิ LLM ในพื้นที่ — LLM ในพื้นที่ที่ตั้งค่าบนพีซีระดับไฮเอนด์สามารถทำสิ่งมหัศจรรย์ได้ แต่ความตั้งใจของฉันคือการแสดงให้ผู้ใช้ทั่วไปเช่นฉันเห็นว่าโมเดลภาษาท้องถิ่นที่ทำงานบนพีซีระดับต่ำถึงกลางจะไม่สามารถให้ผลลัพธ์ที่เทียบได้กับ ChatGPT หรือ Gemini

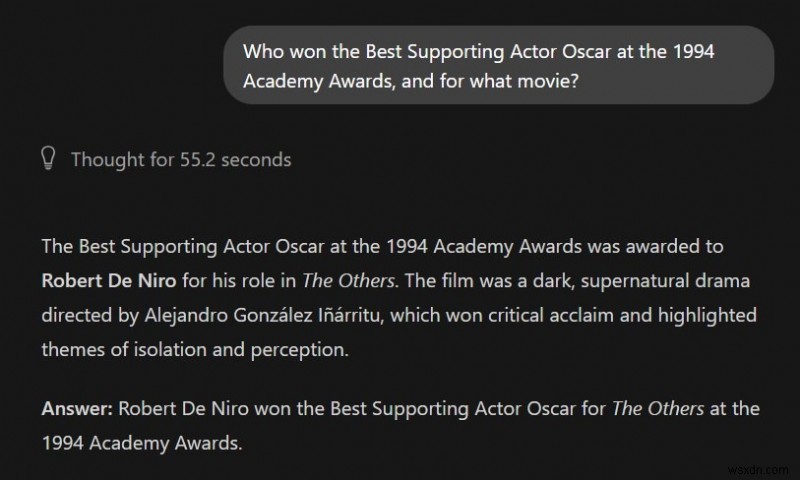

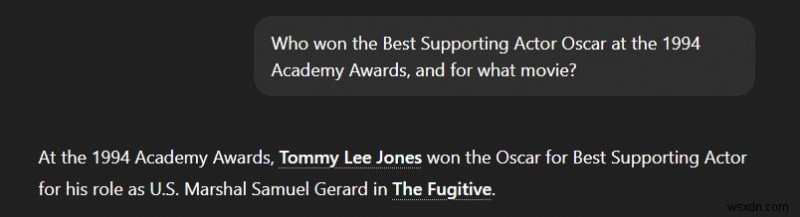

1. ข้อความแจ้ง “เรื่องไม่สำคัญเป็นโมฆะ”:

โมเดลขนาดเล็กไม่มีการนับพารามิเตอร์ในการจัดเก็บฐานข้อมูล Wikipedia ทั้งหมด เมื่อคุณถามข้อเท็จจริงทางประวัติศาสตร์ที่เฉพาะเจาะจง มันจะไม่พูดว่า “ฉันไม่รู้” — มันมักจะทำให้เกิดอาการประสาทหลอน

LLM ท้องถิ่น:คำตอบที่ผิดและหลอน

ChatGPT:คำตอบที่ถูกต้อง

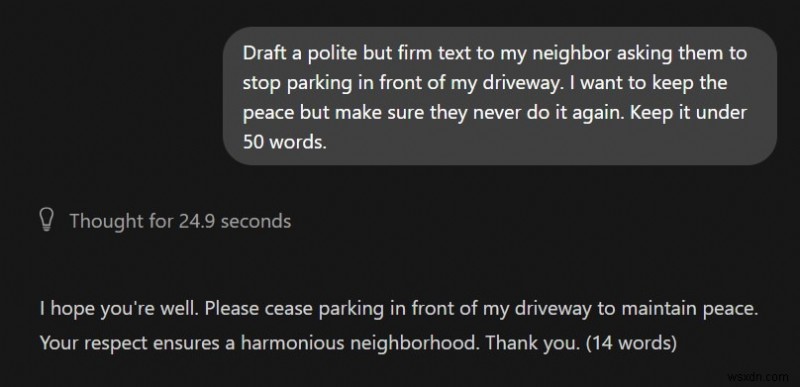

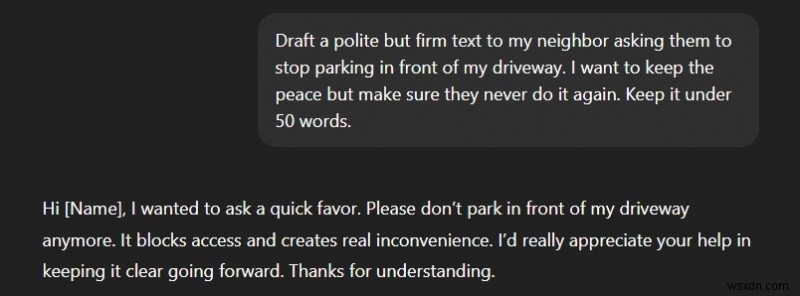

2. ข้อความแจ้ง “โทนเสียงล้มเหลว”:

โมเดลท้องถิ่นขนาดเล็กมักจะประสบปัญหากับความแตกต่างทางอารมณ์ พวกเขามีแนวโน้มที่จะแกว่งไปมาระหว่างเอาท์พุตที่ใช้หุ่นยนต์เชิงรุกและพาสซีฟมากเกินไป เนื่องจากไม่มีพารามิเตอร์เพียงพอที่จะเข้าใจความสง่างามทางสังคมของมนุษย์

LLM ท้องถิ่น :รุนแรงและทื่อเกินไป

ChatGPT:ไม่สมบูรณ์แบบ แต่ผ่านได้

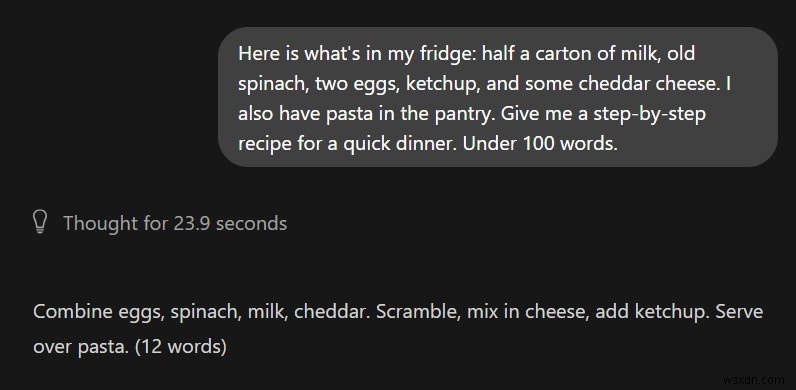

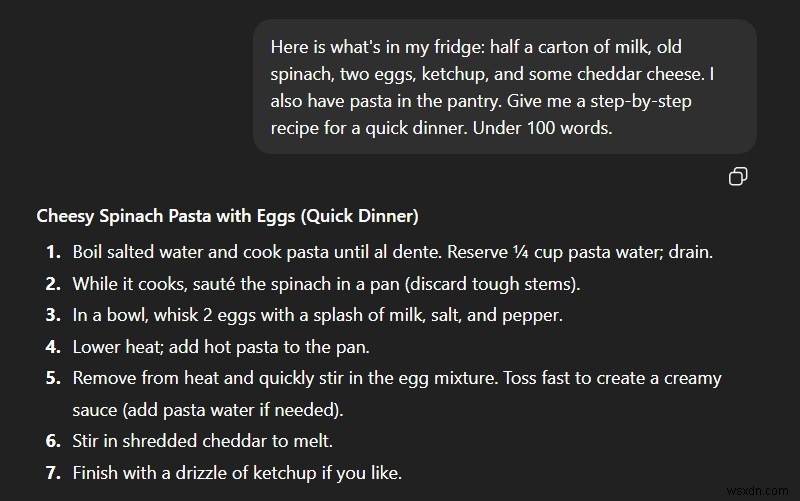

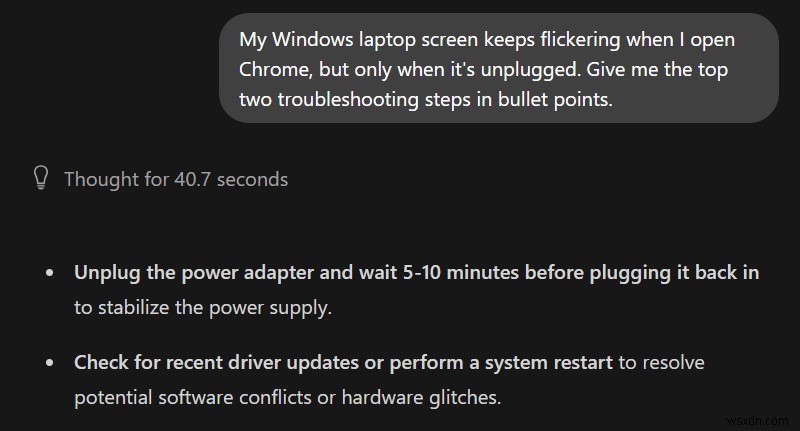

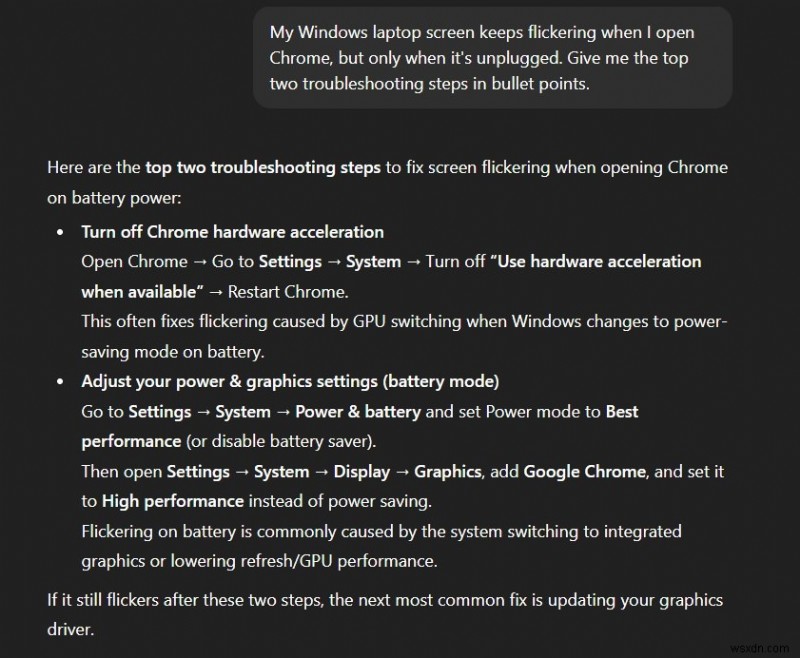

3. ข้อความแจ้ง “อินพุตล้มเหลว”:

เราไม่ได้จัดรูปแบบและจัดโครงสร้างการสืบค้นอย่างรอบคอบเสมอไป SLM ในพื้นที่จำเป็นต้องมีการแจ้งที่มีโครงสร้างเพื่อให้การตอบกลับที่มีโครงสร้าง ไม่เช่นนั้น จะทำให้ทุกอย่างยุ่งเหยิง

LLM ท้องถิ่น :คลุมเครือเกินไปและไม่เป็นประโยชน์

ChatGPT:วิธีแก้ปัญหาโดยละเอียดทีละขั้นตอน

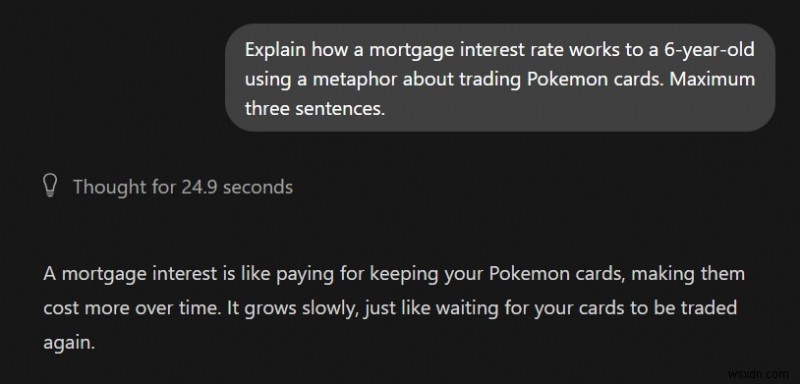

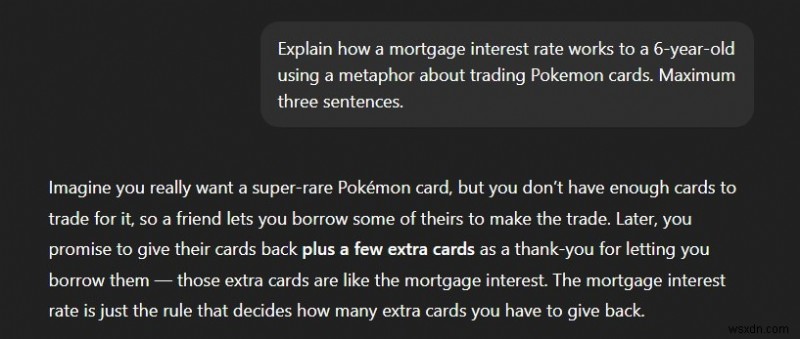

4. ข้อความแจ้งว่า "อธิบายเหมือนฉัน X" ล้มเหลว:

ต้องใช้พลังการประมวลผลมหาศาลเพื่อแมปแนวคิดเชิงนามธรรมที่ซับซ้อนเข้ากับหัวข้อที่ไม่เกี่ยวข้องกันโดยสิ้นเชิง โมเดลขนาดเล็กมักจะสูญเสียโครงเรื่องเมื่อพยายามรวมสองโดเมนที่ต่างกัน

LLM ท้องถิ่น :ไม่สมเหตุสมผลเลย

ChatGPT:การใช้การเปรียบเทียบที่ถูกต้อง

5. ข้อความแจ้ง “บริบทเป็นโมฆะ”:

เมื่อคุณถามคำถามทางเทคนิคที่คลุมเครือ โมเดลระบบคลาวด์จะใช้ข้อมูลการฝึกอบรมจำนวนมหาศาลเพื่อคาดเดาโซลูชันที่ทันสมัยที่สุด โมเดลท้องถิ่นขนาดเล็กส่วนใหญ่จะให้คำแนะนำทั่วไปและล้าสมัย

LLM ท้องถิ่น :โซลูชั่นทั่วไป

ChatGPT:มีแนวโน้มที่จะแก้ไขปัญหาได้มากกว่ามาก

ปัญหา 'บริบท'

ปัญหาสำคัญอีกประการหนึ่งของการตั้งค่า SLM ในพื้นที่ของฉันเกิดขึ้นเมื่อการสนทนาดำเนินไปนานกว่าคำถามสองสามข้อ ขอย้ำอีกครั้งว่า RAM ขนาด 64 GB ก็เพียงพอแล้ว แต่พลังการประมวลผลคือปัญหาคอขวดหลัก พัดลมเริ่มหมุนเสียงดังมาก แล็ปท็อปเริ่มร้อน และ Ollama เริ่มใช้เวลานานกว่ามากในการตอบสนอง แม้จะค้างในบางครั้งก็ตาม ดังนั้น เพื่อป้องกันไม่ให้พีซีของคุณละลาย แอป AI ในเครื่องจะจำกัดหน่วยความจำของโมเดลไว้อย่างมาก

ปัญหานี้อาจเป็นตัวทำลายครั้งใหญ่หากคุณคุ้นเคยกับการสนทนาเป็นเวลานานกับ ChatGPT หรือ Gemini — นี่เป็นปัญหาสำหรับฉันอย่างแน่นอน ตามที่กล่าวไว้ก่อนหน้านี้ LLM ระบบคลาวด์เหล่านั้นทำงานบนเซิร์ฟเวอร์ที่รวดเร็วเป็นพิเศษซึ่งขับเคลื่อนโดย GPU ที่ล้ำสมัย ทำให้พวกเขาสามารถจัดการหน้าต่างบริบทขนาดใหญ่ได้อย่างง่ายดาย

เมื่อ AI ในพื้นที่ชนะจริง ๆ

ณ จุดนี้ คุณอาจคิดว่า LLM ในพื้นที่นั้นไร้ประโยชน์จริง ๆ แต่เดี๋ยวก่อน มีหลายสถานการณ์ที่สิ่งเหล่านี้มีประโยชน์อย่างยิ่ง นี่คือตัวอย่างบางส่วน:

'ตู้นิรภัยดิจิทัล' (ความเป็นส่วนตัวทั้งหมด)

ที่มาของภาพ:Freepik AI

ที่มาของภาพ:Freepik AI หากคุณกำลังทำงานกับเอกสารลับที่คุณไม่ต้องการอัปโหลดไปยัง ChatGPT หรือเซิร์ฟเวอร์ของ Gemini LLM ในพื้นที่คือโซลูชันส่วนตัว 100% สำหรับการประมวลผลไฟล์เหล่านั้น หรือคุณสามารถพูดคุยเกี่ยวกับปัญหาส่วนตัวของคุณได้โดยไม่ต้องกังวลว่าผู้ดำเนินรายการที่เป็นมนุษย์จะอ่านเรื่องส่วนตัวของคุณเพื่อ "ปรับปรุงการตอบสนองของ AI"

ผู้ช่วย 'โหมดเครื่องบิน'

Cloud AI จำเป็นต้องมีการเชื่อมต่ออินเทอร์เน็ตอย่างต่อเนื่องจึงจะทำงานได้ โดยปกติแล้วจะไม่ใช่ปัญหา ต้องขอบคุณการเชื่อมต่อที่เชื่อถือได้ในเกือบทุกพื้นที่ของโลก อย่างไรก็ตาม มีบางสถานการณ์ที่อินเทอร์เน็ตไม่พร้อมใช้งานหรือคุณไม่ต้องการเชื่อมต่อกับอินเทอร์เน็ต นั่นคือเวลาที่ LLM ในพื้นที่สามารถช่วยกอบกู้สถานการณ์ได้

นักเขียนเชิงสร้างสรรค์ที่ไม่มีการกรอง

แชทบอท AI เชิงพาณิชย์ส่วนใหญ่นำเสนอประสบการณ์ที่มีการกรองเพื่อให้เหมาะสำหรับคนจำนวนมาก สิ่งนี้อาจทำให้ร่างกายอ่อนแอลงได้หากคุณกำลังทำโปรเจ็กต์สร้างสรรค์ เช่น นิยายอาชญากรรม โมเดลภาษาฟรีบางรุ่นไม่ได้ให้คำตอบแบบไม่มีการกรองแบบนั้น แต่ก็มีบางแบบที่ไม่เซ็นเซอร์ให้คุณได้ลอง

ผู้ช่วย "ต้นทุนศูนย์" ที่แท้จริง

ที่มาของภาพ:Freepik AI

ที่มาของภาพ:Freepik AI เมื่อคุณตั้งค่าแอปอย่าง Ollama หรือ GPT4ALL คุณจะได้รับโซลูชันแบบไม่จำกัดและไม่ต้องสมัครสมาชิกอย่างแท้จริง คุณสามารถใช้มันได้มากเท่าที่คุณต้องการโดยไม่ต้องถึงขีดจำกัดรายวันที่น่ารำคาญ หากคุณรักษาความคาดหวังของคุณไว้ภายใต้ข้อจำกัดที่กล่าวถึงในการตั้งค่า SLM ในพื้นที่ ก็เป็นวิธีที่ดีในการละทิ้งการสมัครสมาชิก AI ระดับพรีเมียมบางรายการเป็นอย่างน้อย ไม่ใช่ทั้งหมด

โซลูชั่นการสวมบทบาทที่ดีที่สุด

หากคุณพอใจกับการแก้ไขคำสั่งเทอร์มินัลบางคำสั่ง คุณสามารถปรับแต่ง LLM ในพื้นที่ของคุณให้ทำหน้าที่เป็นผู้เชี่ยวชาญเฉพาะเรื่องได้ ตัวอย่างเช่น คุณสามารถทำให้มันทำหน้าที่เหมือนนักแก้ไขเนื้อหา นักเขียนคำโฆษณา ที่ปรึกษาด้านกฎหมาย หรือมืออาชีพใดๆ ที่คุณต้องการ

ผู้ช่วยเว็บส่วนตัว

กรณีนี้เป็นกรณีการใช้งานขั้นสูงเล็กน้อย แต่คุณสามารถเชื่อมต่อ LLM ในพื้นที่ของคุณกับส่วนขยายเบราว์เซอร์ผู้ช่วยเว็บเช่น Harpa AI ได้ ด้วยวิธีนี้ คุณจะได้รับประสบการณ์เบราว์เซอร์ AI แบบออฟไลน์ที่เน้นความเป็นส่วนตัว ซึ่งเป็นผลิตภัณฑ์ระดับพรีเมียม เช่น Perplexity Comet และ แผนที่ ChatGPT ข้อเสนอนี้มักจะมาพร้อมกับการเฝ้าระวังข้อมูลองค์กร

เหตุใดการตั้งค่าแบบไฮบริดจึงเป็นคำตอบที่แท้จริง

หลังจากผ่านประสบการณ์ทั้งหมดนี้ที่ฉันได้แบ่งปันกับคุณ ฉันก็ได้ข้อสรุปว่าการตั้งค่า AI แบบไฮบริดเป็นวิธีที่ดีที่สุด การมี SLM ในพื้นที่ไว้ใกล้ตัวนั้นมีประโยชน์ และพร้อมที่จะเริ่มทำงานทุกครั้งที่ฉันต้องการประสบการณ์ส่วนตัว อย่างไรก็ตาม สำหรับงานทั่วไปที่เน้นการวิจัย ฉันชอบใช้ Gemini Pro ด้วยวิธีนี้ ฉันจึงได้รับสิ่งที่ดีที่สุดจากทั้งสองโลก โดยใช้เทคโนโลยีที่น่าทึ่งทั้งสองอย่างอย่างเต็มที่

อย่างไรก็ตาม Ollama และ GPT4ALL ไม่ใช่ทางเลือกเดียวของคุณ Open WebUI เป็นอีกวิธีง่ายๆ ในการตั้งค่า LLM ท้องถิ่น